在當今數據驅動的商業環境中,阿里巴巴作為全球領先的科技公司,其數據服務產品開發與大數據體系的建設實踐,為行業提供了寶貴的參考。本文基于相關實錄與干貨分享,深入剖析阿里在數據處理服務領域的核心思路、產品架構與關鍵技術。

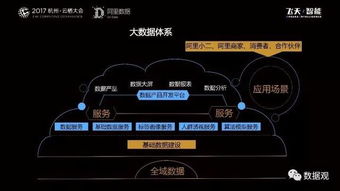

一、大數據體系的頂層設計與演進

阿里的大數據體系并非一蹴而就,而是伴隨著業務規模的指數級增長而持續演進的。其核心目標是構建一個統一、高效、智能的數據資產管理與服務平臺。體系通常分為四層:

- 數據采集與接入層:通過阿里云DataHub、日志服務SLS等產品,實現全渠道、多源異構數據的實時與批量采集,確保數據“匯得全”。

- 數據存儲與計算層:以MaxCompute(ODPS)為核心的數據倉庫,結合實時計算Flink、分析型數據庫AnalyticDB等,形成批流一體的計算能力,保障數據“存得下、算得快”。

- 數據管理與治理層:通過DataWorks提供一站式的數據開發、任務調度、數據質量監控與資產管理功能,實現數據的“管得好”,確保數據可信、可用。

- 數據服務與應用層:將數據資產通過API、數據市場、智能分析平臺(如Quick BI)等形式,安全、高效地服務于業務端,實現數據價值的“用得上”。

二、數據處理服務產品的開發理念

阿里數據服務產品的開發始終圍繞 “讓數據用起來” 這一核心使命,具體體現在:

- 產品化與自助化:將復雜的大數據技術封裝成易用的產品(如DataWorks、Quick BI),降低使用門檻,讓業務人員也能自助完成數據查詢、分析與應用。

- 場景化驅動:產品開發緊密貼合電商、物流、金融、文娛等具體業務場景,解決實際痛點,例如實時風控、個性化推薦、供應鏈優化等。

- 平臺化與生態化:不僅服務內部,更通過阿里云向外部企業輸出成熟的數據處理能力,構建開放的數據生態。

三、數據處理服務的關鍵技術干貨

- 實時數據處理:Flink在阿里的大規模實踐,實現了毫秒級延遲的實時數據管道,支撐了雙11大屏、實時營銷等對時效性要求極高的場景。

- 數據湖倉一體:探索將數據湖的靈活性與數據倉庫的規范性相結合,在MaxCompute基礎上集成OSS對象存儲,實現一份數據支持多種分析范式。

- 智能數據治理:應用機器學習技術進行元數據自動打標、數據質量異常檢測、敏感數據自動識別與脫敏,大幅提升治理效率。

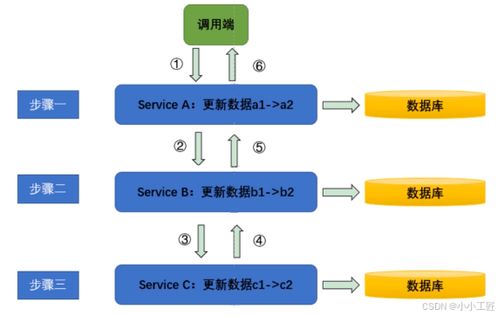

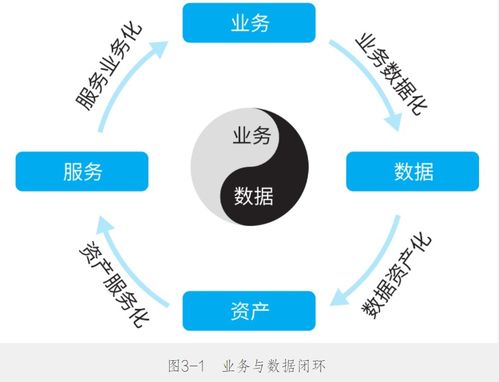

- 數據服務化(Data API):將數據表或查詢邏輯快速封裝成標準、安全的API,供前端應用直接調用,實現了數據后臺與業務前端的解耦與高效協同。

四、挑戰與未來展望

盡管體系成熟,阿里仍面臨數據規模持續膨脹、成本控制、隱私安全合規(如GDPR、個保法)等挑戰。未來趨勢將聚焦于:

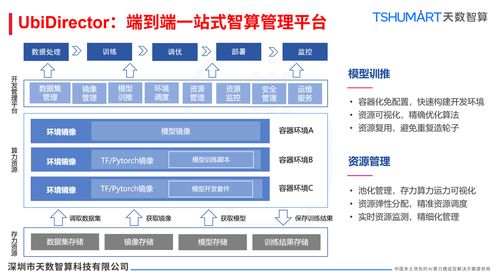

- 云原生數據架構:全面擁抱容器、Serverless等技術,實現更極致的彈性與資源利用率。

- 數據與AI深度融合:將AI能力更深地嵌入數據生產、管理、消費的全鏈路,實現從“數據智能”到“智能數據”的飛躍。

- 數據安全與可信共享:通過隱私計算等技術,在保障數據安全與隱私的前提下,促進數據要素的價值流通。

阿里數據服務產品開發及大數據體系的精髓在于,以強大的技術平臺為基石,以業務價值為導向,通過產品化手段將數據處理能力民主化、普惠化。其演進歷程與實戰經驗,為各行各業構建自身的數據能力提供了系統性的方法論與可落地的路徑參考。